W swojej pracy w autoencoders do klasyfikacji tekst Hinton i Salakhutdinov wykazały wykres wytwarzanego przez 2 wymiarowe LSA (co jest ściśle związane z PCA)  .

.

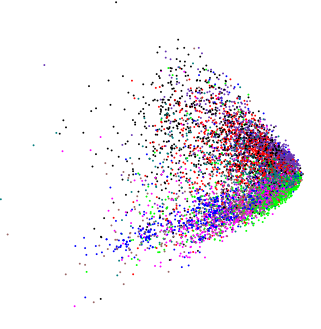

Stosując PCA do absolutnie różnych nieco nieco wymiarowych danych, otrzymałem podobnie wyglądający wykres:  (z wyjątkiem tego przypadku naprawdę chciałem wiedzieć, czy jest jakaś struktura wewnętrzna).

(z wyjątkiem tego przypadku naprawdę chciałem wiedzieć, czy jest jakaś struktura wewnętrzna).

Jeśli wprowadzimy losowe dane do PCA, otrzymamy kroplę w kształcie dysku, więc ten kształt w kształcie klina nie jest losowy. Czy to samo coś znaczy?

data-visualization

pca

macleginn

źródło

źródło

Odpowiedzi:

Zakładając, że zmienne są dodatnie lub nieujemne, krawędzie krawędzi są tylko punktami, powyżej których dane stałyby się odpowiednio 0 lub ujemne. Ponieważ takie rzeczywiste dane są zwykle wypaczone, widzimy większą gęstość punktów na dolnym końcu ich rozkładu, a zatem większą gęstość w „punkcie” klina.

Mówiąc bardziej ogólnie, PCA to po prostu obrót danych, a ograniczenia na tych danych będą ogólnie widoczne w głównych składnikach w taki sam sposób, jak pokazano w pytaniu.

Oto przykład wykorzystujący kilka zmiennych logarytmicznych o rozkładzie normalnym:

W zależności od rotacji sugerowanej przez dwa pierwsze komputery PC możesz zobaczyć klin lub nieco inną wersję, pokazaną tutaj w 3D za pomocą (

ordirgl()zamiastplot())Tutaj w 3d widzimy wiele kolców wystających z masy centralnej.

Dla losowych zmiennych Gaussa (Xja∼ ( N) ( μ = 0 , σ= 1 ) ), gdzie każdy ma tę samą średnią i wariancję, widzimy sferę punktów

A dla jednolitych dodatnich zmiennych losowych widzimy sześcian

Zauważ, że tutaj dla ilustracji pokazuję mundur używając tylko 3 zmiennych losowych, stąd punkty opisują sześcian w 3d. Przy wyższych wymiarach / większej liczbie zmiennych nie możemy idealnie przedstawić hipersześcianu 5d w 3d, a zatem wyraźny kształt „sześcianu” ulega nieco zniekształceniu. Podobne problemy wpływają na inne pokazane przykłady, ale nadal łatwo zauważyć ograniczenia w tych przykładach.

Dla twoich danych transformacja logiczna zmiennych przed PCA pociągnie za sobą ogony i rozciągnie zbite dane, tak jak możesz użyć takiej transformacji w regresji liniowej.

Inne kształty mogą pojawiać się na wykresach PCA; jeden taki kształt jest artefaktem reprezentacji metrycznej zachowanym w PCA i jest znany jako podkowa . W przypadku danych o długim lub dominującym gradiencie (próbki ułożone wzdłuż jednego wymiaru ze zmiennymi zwiększającymi się od 0 do maksimum, a następnie zmniejszającymi się ponownie do 0 wzdłuż części danych, są dobrze znane z generowania takich artefaktów.

co tworzy ekstremalną podkowę, w której punkty na końcach osi wyginają się z powrotem w środek.

źródło